线性回归

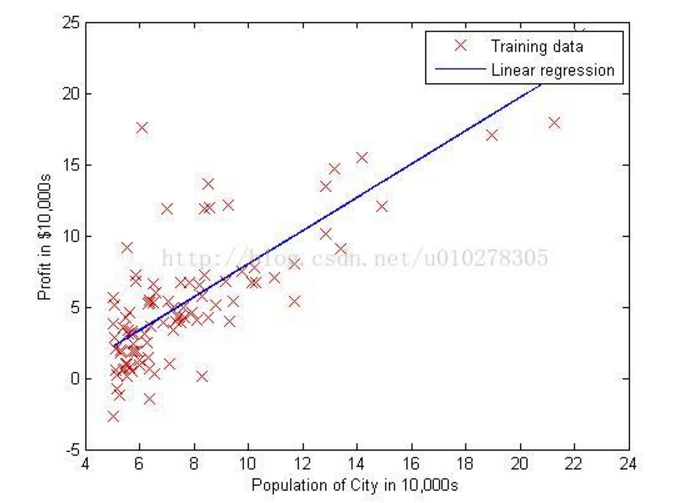

用一个线性函数对提供的已知数据进行拟合,最终得到一个线性函数,使这个函数满足我们的要求(如具有最小平方差,随后我们将定义一个代价函数,使这个目标量化),之后我们可以利用这个函数,对给定的输入进行预测(例如,给定房屋面积,我们预测这个房屋的价格)。如下图所示:

假设我们最终要的得到的假设函数具有如下形式:

其中,x是我们的输入,theta是我们要求得的参数。

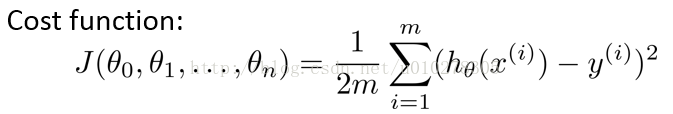

代价函数如下:

|

|

正态分布(Normal distribution)又名高斯分布(Gaussian distribution),是一个在数学、物理及工程等领域都非常重要的概率分布,在统计学的许多方面有着重大的影响力。

若随机变量X服从一个数学期望为μ、标准方差为σ2的高斯分布,记为:

X∼N(μ,σ2),

则其概率密度函数为:

正态分布的期望值μ决定了其位置,其标准差σ决定了分布的幅度。因其曲线呈钟形,因此人们又经常称之为钟形曲线。我们通常所说的标准正态分布是μ = 0,σ = 1的正态分布

我们的目标是使得此代价函数具有最小值。

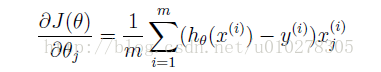

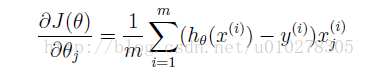

为此,我们还需要求得代价函数关于参量theta的导数,即梯度,具有如下形式:

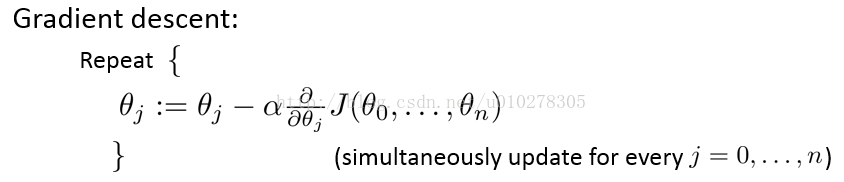

有了这些信息之后,我们就可以用梯度下降算法来求得theta参数。过程如下:

逻辑回归

相比于线性回归,逻辑回归只会输出一些离散的特定值(例如判定一封邮件是否为垃圾邮件,输出只有0和1),而且对假设函数进行了处理,使得输出只在0和1之间。

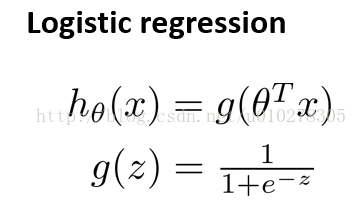

假设函数如下:

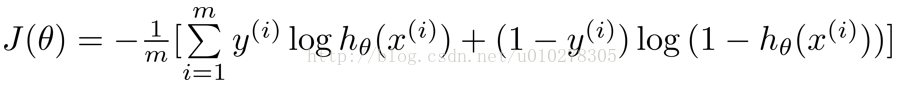

代价函数如下:

note:

在这里可以看到逻辑回归使用伯努利分布来处理误差

伯努利分布(Bernoulli distribution)又名两点分布或0-1分布,介绍伯努利分布前首先需要引入伯努利试验(Bernoulli trial)。

伯努利试验是只有两种可能结果的单次随机试验,即对于一个随机变量X而言:

伯努利试验都可以表达为“是或否”的问题。例如,抛一次硬币是正面向上吗?刚出生的小孩是个女孩吗?等等

如果试验E是一个伯努利试验,将E独立重复地进行n次,则称这一串重复的独立试验为n重伯努利试验。

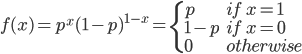

进行一次伯努利试验,成功(X=1)概率为p(0<=p<=1),失败(X=0)概率为1-p,则称随机变量X服从伯努利分布。伯努利分布是离散型概率分布,其概率质量函数为:

梯度函数如下,观察可知,形式与线性回归时一样:

一般线性回归(softmax)

线性回归 是以 高斯分布 为误差分析模型; 逻辑回归 采用的是 伯努利分布 分析误差。

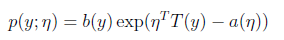

而高斯分布、伯努利分布、贝塔分布、迪特里特分布,都属于指数分布。

而一般线性回归,在x条件下,y的概率分布 p(y|x) 就是指 指数分布.

经历最大似然估计的推导,就能导出一般线性回归的 误差分析模型(最小化误差模型)。

softmax回归就是 一般线性回归的一个例子。

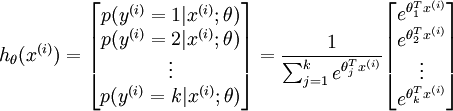

有监督学习回归,针对多类问题(逻辑回归,解决的是二类划分问题),如数字字符的分类问题,0-9,10个数字,y值有10个可能性。

而这种可能的分布,是一种指数分布。而且所有可能的和 为1,则对于一个输入的结果,其结果可表示为:

参数是一个k维的向量。

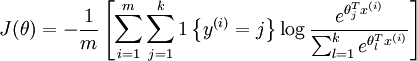

而代价函数:

而对于softmax的求解,没有闭式解法(高阶多项方程组求解),仍用梯度下降法,或L-BFGS求解。

当k=2时,softmax退化为逻辑回归,这也能反映softmax回归是逻辑回归的推广。

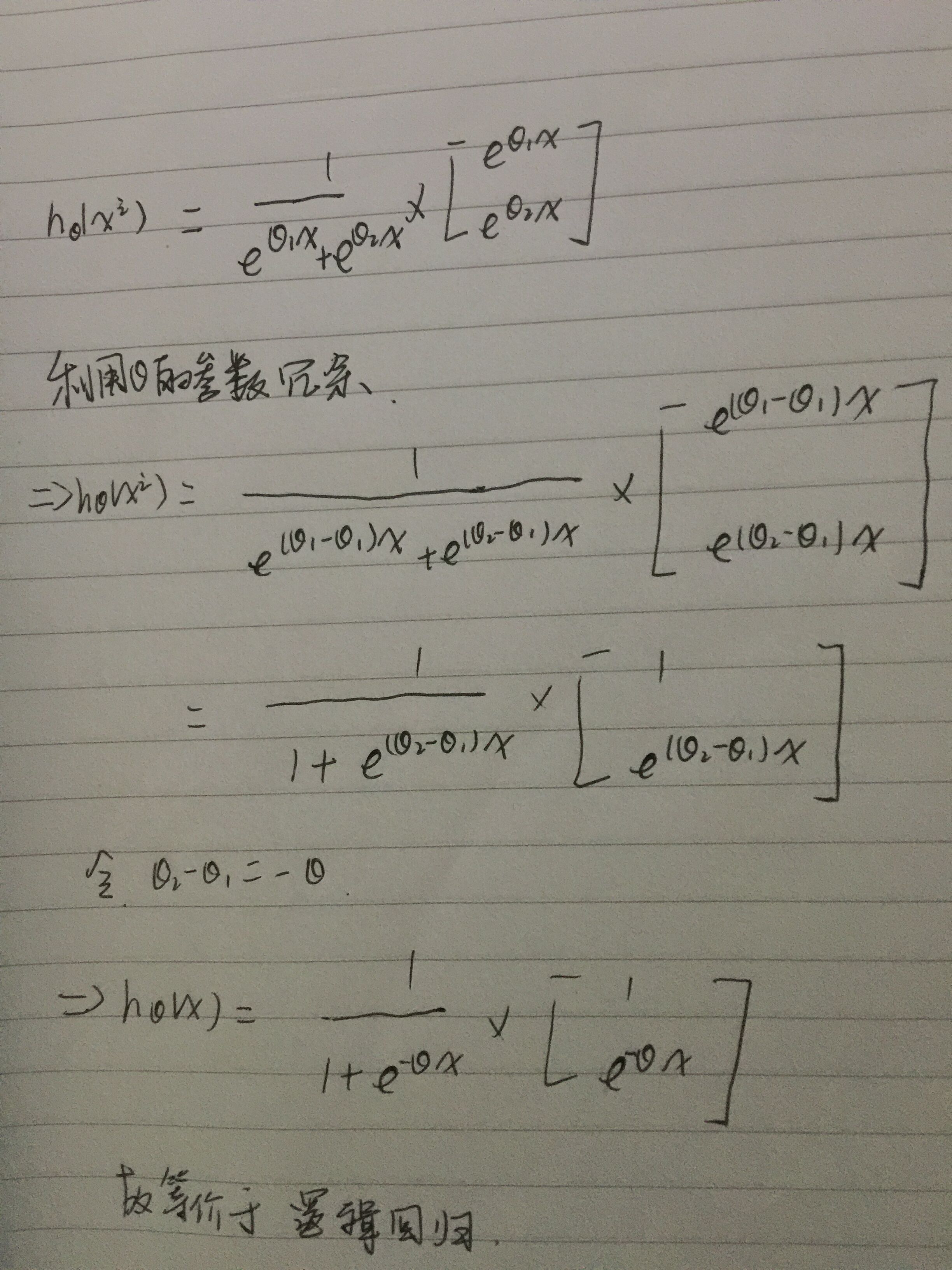

证明如下: